📊 오늘의 IT 트렌드 한눈에 보기

안녕하세요! 성징어의 IT 잉크사이트(IT Ink-Sight) 성징어입니다.

오늘은 AI 관련 최신 IT 뉴스를 중심으로 주요 동향과 핵심 이슈들을 분석해드리겠습니다.

최근 IT 업계는 ‘더 큰 AI 모델이 더 좋다’는 오랜 관념에 중대한 변화를 맞고 있습니다. LLM(대형 언어 모델) 중심에서 벗어나 SLM(소형 언어 모델)이 새로운 핵심 동력으로 떠오르고 있는데요.

엔비디아 연구진은 SLM이 차세대 지능형 기업의 진정한 중추가 될 수 있다고 분석했습니다. 효율성, 비용, 실용적 배포 측면에서 ‘큰 모델이 항상 최고는 아니다’라는 강력한 메시지를 시장에 던지고 있습니다.

SLM의 부상은 에이전트 AI(Agentic AI) 재정의를 넘어, 엣지 AI 시대를 본격적으로 열고 있습니다. 기기 내 로컬 구동을 통한 지연 시간 단축, 개인 정보 보호 강화, 비용 효율적 배포가 핵심 장점입니다.

온디바이스 AI 및 체화 AI(Embodied AI) 발전에 맞물려, 스마트폰, IoT 등 다양한 엣지 디바이스에 AI가 깊숙이 통합될 전망입니다. 고성능 LLM의 역할은 여전하지만, 이제는 목적에 맞는 AI 모델 선택이 더욱 중요합니다.

거대 AI 시대의 역설: 소형 언어 모델(SLM)의 부상과 엣지 AI 혁명

거대 언어 모델(LLM)이 주도하던 AI 시장에 역설적인 변화가 감지됩니다. ‘크면 클수록 좋다’는 인식을 깨고 소형 언어 모델(SLM)이 부상하고 있기 때문입니다.

효율성, 비용, 실용적 배포 측면에서 SLM은 LLM의 강력한 대안입니다. NVIDIA 연구진은 SLM이 차세대 지능형 기업의 중추가 될 것이라 전망하며, 에이전트 AI의 재정의를 이끌 잠재력을 강조합니다.

특히 SLM은 엣지 AI 혁명을 이끄는 핵심입니다. 클라우드 없이 휴대폰, IoT 등 로컬 기기에서 직접 구동되며, 지연 시간 단축과 개인 정보 보호를 강화합니다. 이는 온디바이스 및 체화 AI 시대를 가속화하며 산업 전반의 패러다임을 전환할 것입니다.

이제 AI는 규모보다 목적에 최적화된 형태로 진화 중입니다. SLM의 부상은 AI가 우리 삶에 더욱 밀접하게 통합될 미래를 예고합니다.

온디바이스 AI, 체화 AI로 확장되는 SLM의 실질적 가치

최근 AI 패러다임의 핵심 변화는 바로 소형 언어 모델(SLM)이 온디바이스 AI의 실질적인 가치를 증명하며 그 영역을 체화 AI(Embodied AI)로 확장하고 있다는 점입니다.

기존의 ‘거대 모델이 곧 더 나은 모델’이라는 인식이 점차 바뀌고 있습니다. 엔비디아 연구진의 분석처럼, SLM은 차세대 지능형 기업의 진정한 근간이 될 잠재력을 보여주고 있네요.

이는 SLM이 효율성, 비용, 그리고 실질적인 배포 측면에서 에이전트 AI를 재정의할 준비가 되어 있기 때문입니다. 특히 가벼운 비전-언어-액션 기반의 체화 에이전트 구축 가능성은 이 분야의 큰 진전으로 평가됩니다.

SLM은 클라우드 의존도를 줄이고 휴대폰, 노트북, IoT 기기 등 다양한 디바이스에서 로컬로 구동되는 엣지 AI 통합을 가능하게 합니다. 이는 지연 시간을 단축하고 개인 정보 보호를 강화하는 중요한 이점을 제공합니다.

나아가 온디바이스 AI는 체화 AI의 결정체로 자리매김하며 새로운 패러다임 전환을 예고합니다. 작은 온디바이스 AI가 정밀한 로봇 핸드와 같은 물리적 AI로 이어지는 흐름은 SLM이 현실 세계와 상호작용하는 AI의 시대를 본격적으로 열고 있음을 시사합니다.

LLM의 그림자: 보안 취약점과 특정 목적 AI 모델의 부상

최근 AI 분야는 거대 언어 모델(LLM)의 활약이 두드러졌지만, 그 이면에는 간과할 수 없는 그림자가 드리워져 있습니다.

특히 LLM의 보안 취약성은 큰 문제로 떠오르고 있습니다. 단돈 12달러 도메인과 위키피디아 편집으로 LLM을 속일 수 있었다는 소식은 모델 신뢰성에 의문을 던지며, 대규모 모델의 오염 취약성을 드러냅니다.

이러한 한계와 더불어 효율성, 비용, 실용적 배포 필요성이 소형 언어 모델(SLM)과 특정 목적 AI 모델의 부상을 이끌고 있습니다. ‘더 큰 모델이 더 좋다’는 통념과 달리, 엔비디아 연구진은 SLM이 차세대 지능형 기업의 중추가 될 수 있다고 강조합니다.

1930년대 이전 텍스트로 훈련된 ‘Talkie-1930’처럼, 특정 목적에 특화된 모델들은 LLM의 범용성 대신 정밀한 기능을 제공합니다. 에지 AI 시대에 기기 로컬 실행이 가능한 SLM은 지연 시간을 줄이고 개인 정보 보호를 강화하며, 체화 AI 등 특정 분야에서 그 가치를 입증 중입니다. 이는 AI 패러다임이 ‘목적에 맞는 최적화’로 전환되는 신호입니다.

고성능 LLM 인프라 최적화와 신뢰성 확보의 딜레마

초거대 언어 모델(LLM)의 잠재력은 엄청나지만, 이를 실제로 구현하고 유지하는 과정은 만만치 않은 도전 과제를 던져줍니다. 특히 고성능 LLM을 위한 인프라 최적화와 그 결과물의 신뢰성 확보는 오늘날 IT 업계가 직면한 핵심 딜레마 중 하나입니다.

클라우드플레어와 같은 기업들이 ‘초대형 언어 모델 실행을 위한 기반 구축’에 나서며, 맞춤형 기술 스택과 엔지니어링 최적화를 통해 고성능 AI 추론을 가능하게 하려는 노력이 대표적입니다. 이는 방대한 컴퓨팅 자원과 복잡한 아키텍처를 효율적으로 운영하기 위한 필수적인 과정입니다.

또한, 파네시아 같은 반도체 기업들은 대형 링크 칩 공급을 통해 메모리 장벽을 허물고 PCIe, CXL 같은 차세대 기술로 LLM 인프라의 성능 한계를 극복하려 합니다. 이러한 하드웨어 혁신은 LLM의 연산 효율성을 극대화하고 처리 속도를 높이는 데 결정적인 역할을 합니다.

하지만 이러한 최적화 노력에도 불구하고, LLM의 신뢰성 문제는 여전히 큰 숙제로 남아있습니다. ‘대규모 언어 모델을 속이는 것이 점점 더 간단해진다’는 보도처럼, 적은 비용과 간단한 조작으로도 LLM의 판단을 왜곡시킬 수 있음이 드러나고 있습니다. 이는 LLM이 제공하는 정보의 정확성과 보안성에 대한 근본적인 의문을 제기합니다.

결국, LLM 인프라를 최적화하여 성능과 비용 효율성(GPU 비용 낭비 최소화 등)을 높이는 동시에, 모델 자체의 신뢰성과 보안을 확보하는 것은 상충하는 목표가 될 수 있습니다. 앞으로 IT 시장은 단순히 ‘더 크고 빠른’ 모델을 넘어, ‘더 신뢰할 수 있고 안전한’ LLM을 위한 기술 개발에 더욱 집중할 것입니다. 이는 AI 윤리 및 거버넌스 분야의 중요성을 더욱 부각시키며, 새로운 산업 표준과 기술 패러다임을 형성할 것으로 예상됩니다.

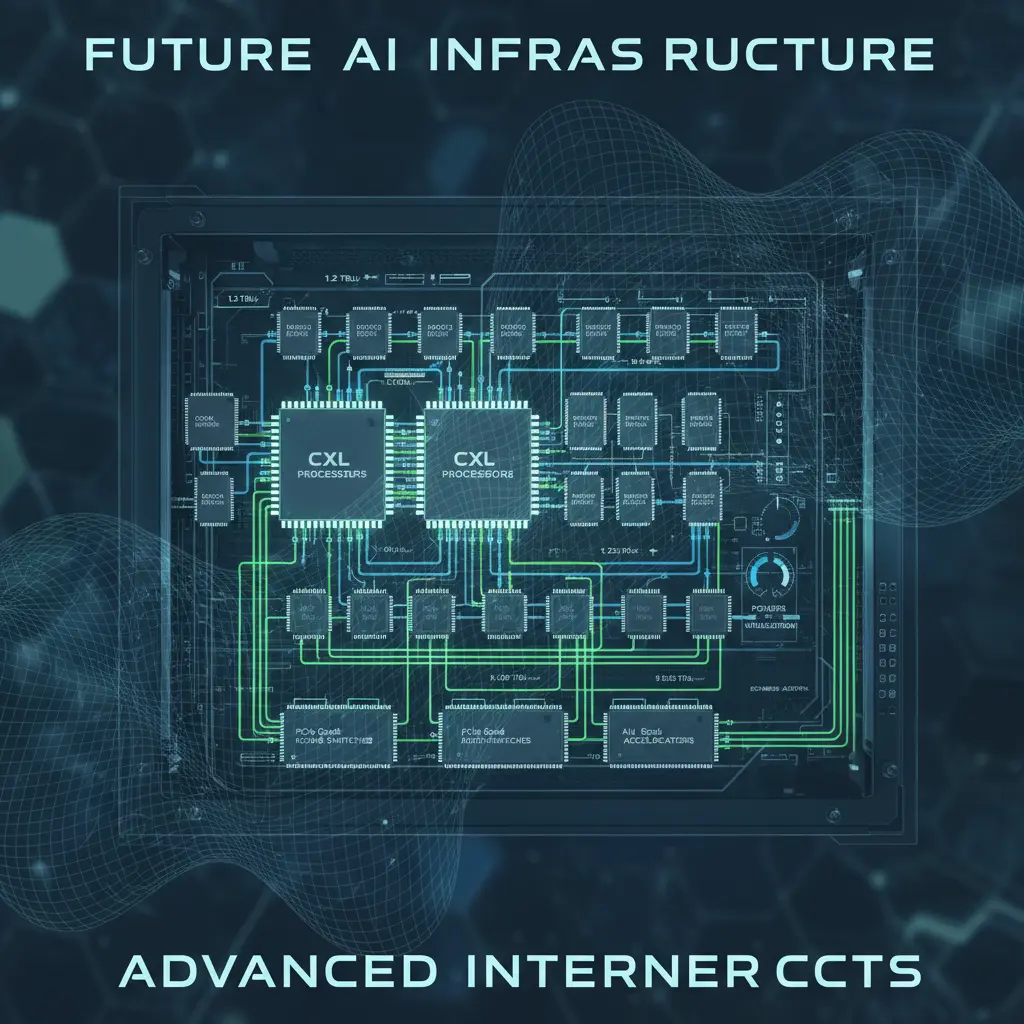

차세대 AI 인프라의 핵심 동맥: CXL 및 고성능 링크 칩 기술의 진화

소형 언어 모델(SLM)과 엣지 AI 시대가 본격화되면서, 이를 뒷받침할 차세대 인프라의 중요성이 커지고 있습니다. 데이터 처리 효율을 극대화하는 고성능 링크 칩 기술은 AI 패러다임 전환의 핵심 동맥으로 부상하고 있네요. 메모리 병목 현상 해결을 통한 시스템 성능 최적화가 글로벌 AI 경쟁력의 관건입니다.

이 흐름 속, 파네시아는 올 하반기 대형 링크 칩 공급으로 메모리 장벽을 허물 계획입니다. PCIe 6.4 및 CXL 3.2 퓨전 스위치 생산과 ‘하이퍼CXL’ 솔루션 공개는 주목할 만하죠. 클라우드플레어가 고성능 LLM 추론을 위해 맞춤형 스택을 구축하듯, 이 기술은 SLM 및 온디바이스 AI 환경에서 데이터 접근과 처리를 획기적으로 가속화하며 글로벌 AI 생태계 성능 향상을 이끌 것으로 기대됩니다.

오늘의 핵심 포인트 3가지

최근 IT 업계의 뜨거운 감자로 떠오른 소형 언어 모델(SLM)의 부상은 단순히 LLM의 경량화 수준을 넘어, AI 패러다임의 근본적인 변화를 예고하고 있습니다. 오늘 주요 뉴스들을 살펴보며, 이 중요한 흐름 속에서 우리가 주목해야 할 세 가지 핵심 포인트를 정리해봤습니다.

첫째, SLM은 차세대 AI의 ‘진정한 중추’로 부상하고 있습니다. 엔비디아 연구진의 분석에 따르면, SLM이 “다음 세대 지능형 기업의 진정한 중추(true backbone)”가 될 수 있다는 전망이 힘을 얻고 있습니다. (기사 1) 이는 오랫동안 AI 대화를 지배했던 ‘더 큰 모델 = 더 좋다’는 통념에서 벗어나, 특정 작업에 최적화된 효율성과 실용성으로 새로운 가치를 창출하며 AI 산업의 핵심 동력으로 자리매김할 잠재력을 보여줍니다. 무작정 큰 모델을 추구하기보다, 필요한 곳에 필요한 만큼의 지능을 배치하는 실용주의가 대두되는 것이죠.

둘째, 엣지 AI와 체화 AI 시대의 개막을 SLM이 가속화하고 있습니다. SLM은 “디바이스에서 로컬로 실행될 수 있어(run locally on devices)” 클라우드 의존도를 낮추고 “지연 시간을 줄이며 개인 정보 보호를 강화”하는 “엣지 AI 통합”의 핵심 열쇠로 지목됩니다. (기사 5) 이는 스마트폰, 노트북, IoT 기기 등 다양한 엣지 디바이스에서 AI가 직접 구동되는 환경을 의미하며, AI가 우리의 일상 속으로 더욱 깊숙이 파고드는 계기가 될 것입니다.

더 나아가, SLM은 “효율성, 비용, 실용적 배포” 측면에서 “에이전트 AI를 재정의”할 수 있으며, “작은 온디바이스 AI”와 “체화 AI”의 결정체로 새로운 패러다임 전환을 이끌 것이라는 전망도 나옵니다. (기사 2, 8) 물리적 세계와 상호작용하는 로봇, 자율주행차 등 체화 AI 분야에서 SLM의 역할이 더욱 커질 것으로 기대됩니다.

셋째, LLM과 SLM의 전략적 역할 분담 시대가 본격적으로 도래했습니다. 이제 AI 모델 선택은 단순히 크기 경쟁이 아닌, 용도와 목적에 따른 전략적 접근으로 진화하고 있습니다. “LLM vs SLM: 언제 대규모 언어 모델을 사용하고 언제 소규모 언어 모델로 충분한가”라는 질문은, 각 모델의 장단점을 명확히 이해하고 최적의 조합을 찾아야 하는 시점임을 시사합니다. (기사 4)

클라우드 기반의 방대한 지식과 추론 능력을 가진 LLM이 거시적인 문제 해결에 집중한다면, 엣지 기반의 경량 SLM은 특정 디바이스나 상황에 맞는 즉각적이고 효율적인 작업을 수행하며 상호 보완적인 관계를 형성할 것입니다. 이는 AI 시스템 설계의 유연성과 효율성을 극대화하는 방향으로 나아감을 의미합니다.

이러한 흐름 속에서 저는 기업과 개발자들이 무조건적인 대형 모델 추구에서 벗어나, 실제 사용 시나리오와 비용 효율성을 고려한 SLM 도입을 적극적으로 검토해야 한다고 생각합니다. 특히 엣지 디바이스와 결합된 새로운 서비스 모델 발굴에 집중한다면, 다가오는 AI 패러다임 전환의 선두 주자가 되어 시장을 선점할 수 있을 것입니다. 변화의 물결 속에서 현명한 전략적 선택이 필요한 때입니다.

🔗 기사 원문 보러가기

- The Case for Using Small Language Models – Datentreiber

- How to Build a Lightweight Vision-Language-Action-Inspired Embodied Agent with Latent World Modeling and Model Predictive Control – MarkTechPost

- Building the foundation for running extra-large language models

- LLM vs SLM: When to Use a Large Language Model and When a Small Language Model Is Enough | by Yash Jain | AlgoMart | Apr, 2026 | Medium

- The Evolution of the AI Supercycle: From Infrastructure to Application

- Vintage chatbot lives in the past like an elderly relative • The Register

- Fooling large language models just keeps getting simpler • The Register

- AI 엑스포 출격 예고한 씨이랩, “GPU 비용 낭비, 금액으로 환산”…방법론 공개

- Meet Talkie-1930: A 13B Open-Weight LLM Trained on Pre-1931 English Text for Historical Reasoning and Generalization Research – MarkTechPost

- 정명수 파네시아 “하반기 중 대형 링크 칩 공급…메모리 장벽 허물 것” – 디지털데일리

✅ AI 외 더 많은 IT 정보는 카테고리 전체보기에서 확인 가능합니다.